Hoy en día existen redes wifi en casi todos los hogares, oficinas, restaurantes y cafeterías. Investigadores del Instituto Tecnológico de Karlsruhe (Alemania) estudiaron cómo funcionan estas redes inalámbricas y descubrieron una nueva forma de identificar a las personas incluso si no llevan un celular consigo.

Para su

investigación, los expertos llevaron a cabo un experimento con

197 participantes y casi con un

100 % de precisión pudieron inferir la identidad de las personas que simplemente pasaban por lugares en los que había wifi. El profesor Thorsten Strufe, coautor del estudio, explica que, observando la propagación de ondas de radio, pudieron crear una

imagen del entorno y de las personas presentes.

De acuerdo a Strufe, el mecanismo funciona de forma similar a una cámara normal, con la diferencia de que, en su caso, se utilizaron ondas de radio en lugar de ondas de luz para el reconocimiento. "Por lo tanto, no importa si llevas un dispositivo wifi o no. [...] Basta con que otros dispositivos wifi a tu alrededor estén activos", agrega.

Por su parte, el profesor Julian Todt, quien también participó en el estudio, señala que esta tecnología convierte a cualquier rúter en "un medio potencial de vigilancia". "Si pasas habitualmente por una cafetería con red wifi, podrías ser identificado allí sin darte cuenta y ser reconocido posteriormente, por ejemplo, por autoridades públicas o empresas", advierte.

A diferencia de otros métodos de espionaje a través de wifi, esta nueva técnica no necesita ningún 'hardware' específico, solamente un rúter común y corriente a través del cual pueda explotar la comunicación de los usuarios conectados a una red local inalámbrica.

Otro de los autores del estudio, el estudiante de doctorado Felix Morsbach, subraya que, si bien es cierto que existen métodos mucho más sencillos para espiar a las personas, como, por ejemplo, accediendo a cámaras de vigilancia o videoporteros, las "omnipresentes" redes inalámbricas podrían convertirse en una "infraestructura de vigilancia casi integral", puesto que son invisibles y no levantan sospechas.

Dúrov acusa a Francia de intentar convertir los teléfonos de los europeos en dispositivos de espionaje

El fundador de Telegram, Pável Dúrov, advirtió este martes que

"hoy, la Unión Europea estuvo a punto de prohibir el derecho a la privacidad". "Estaba a punto de votar una ley que obligaría a las aplicaciones a

escanear todos los mensajes privados, convirtiendo el teléfono de cualquier persona en

una herramienta de espionaje",

escribió el empresario en su canal de Telegram.

De acuerdo con sus palabras, "la iniciativa" para promover "esta ley autoritaria" ha sido liderada por Francia. Dúrov señaló que la idea fue apoyada por el actual ministro del Interior francés y su predecesor, Laurent Nuñes y Bruno Retailleau, respectivamente. "El pasado marzo, declararon que la Policía debería ver los mensajes privados de los ciudadanos franceses", recordó.

El empresario agregó que el partido Los Republicanos (Les Républicains), así como el partido Renacimiento (Renaissance), fundado por el presidente francés Emmanuel Macron, también votaron a favor, mientras que Alemania se opuso a la propuesta de espiar a la ciudadanía.

"Se supone que estas medidas combaten la delincuencia, pero su verdadero objetivo es la gente común. No detendrían a los delincuentes, que podrían simplemente usar VPN o sitios web especiales para ocultarse. Los mensajes de funcionarios y policías tampoco serían escaneados, ya que la ley los exime convenientemente de la vigilancia. Solo ustedes, ciudadanos comunes, correrían el riesgo de que sus mensajes y fotos privadas se vieran comprometidos", explicó Dúrov.

El empresario alertó que "los derechos fundamentales de los franceses —y de todos los europeos— siguen en peligro" mientras los líderes franceses continúen luchando por acceder a los mensajes privados de la población. Dúrov precisó que esta información ha sido divulgada a todos los usuarios de Telegram en Francia. "Es importante que la gente conozca los nombres de quienes intentan robarles la libertad", concluyó.

Palantir: La máquina de vigilancia 'pre-crimen' privatizada de la CIA

Palantir no es solo una empresa tecnológica, es la versión privatizada y renombrada del programa “Total Information Awareness” del Pentágono posterior al 11-S, creado cuando la protesta pública amenazó con desfinanciar el proyecto estatal de vigilancia.

Revelaciones clave de Whitney Web:

- Fundada con John Poindexter, director de TIA, como su "padrino"

- Durante 5–6 años, su único cliente fue la CIA a través de In-Q-Tel

- Ingenieros trabajaban regularmente dentro de la sede de la CIA adaptando el sistema

- Etiqueta a individuos como "subversivos", recopilando todo sobre ellos

- Usado en la policía predictiva y la aplicación de la ley migratoria

- Peter Thiel y Epstein apoyaron una empresa relacionada de pre-crimen, Carbyne, con Ehud Barak

Una arquitectura de vigilancia privatizada — construida para rastrear, predecir y controlar — ahora opera lejos de la supervisión pública.

‘Excesos de la democracia’: Europa está eliminando el internet libre y las comunicaciones privadas

El propietario de X, Elon Musk, ha republicado una advertencia del fundador de Telegram, Pavel Durov, sobre la cruzada de la UE contra la libertad de expresión y la privacidad.

¿Qué hay detrás de esto?

“Chat Control es una regulación controvertida de la UE” bajo la cual “los mensajeros y redes sociales escanearían automáticamente los mensajes y archivos adjuntos de los usuarios,” dice el experto en ciberseguridad Sergey Vakulin.

El Consejo de la Unión Europea está impulsando la iniciativa bajo el pretexto de la protección infantil.

Se basa en dos puntos principales: escanear el contenido y verificar la edad de los usuarios, exigiendo que las plataformas revisen los mensajes en un dispositivo antes del cifrado, lo que de facto hace que este cifrado sea inútil.

“Tus mensajes podrían ser leídos por prácticamente cualquiera: se almacenarían por un cierto período, y terceros tendrían acceso no solo a los mensajes sino también a los archivos multimedia. Como todos sabemos, estos datos podrían filtrarse fácilmente,” dice Vakulin.

Las solicitudes a chatbots de IA también probablemente se convertirán en un objetivo, según el experto en seguridad informática Evgeny Tsarev, CEO de RTM Group.

“Los creadores de ChatGPT declararon que monitorearían los intentos de los usuarios de aprender algo peligroso — por ejemplo, cómo hacer venenos.” “Lo presentan como si esta información se compartiera con las fuerzas del orden — y está claro a qué fuerzas del orden se refieren: a las estadounidenses.”

Actualmente, la UE ha retrasado la ley de “control de chat” debido a preocupaciones de privacidad planteadas por algunos de sus estados miembros. Alemania frenó el proyecto a pesar de los intentos agresivos de Dinamarca y Francia para aprobarlo.

Vakulin cree que hay una gran probabilidad de que eventualmente se adopte. “Solo piensen en Edward Snowden, quien expuso cómo el gobierno de EE. UU. vigila a otros usuarios. No es nada nuevo.”

¿Por qué Europa lideraría una iniciativa que abusa de la privacidad de sus ciudadanos? “Yo lo llamaría ‘excesos de la democracia’,” dice Vakulin, añadiendo que la tendencia es clara: pronto no habrá internet libre ni comunicación libre en Europa.

El Contraproyecto: Cuando la democracia europea externaliza la vigilancia del pensamiento

REST

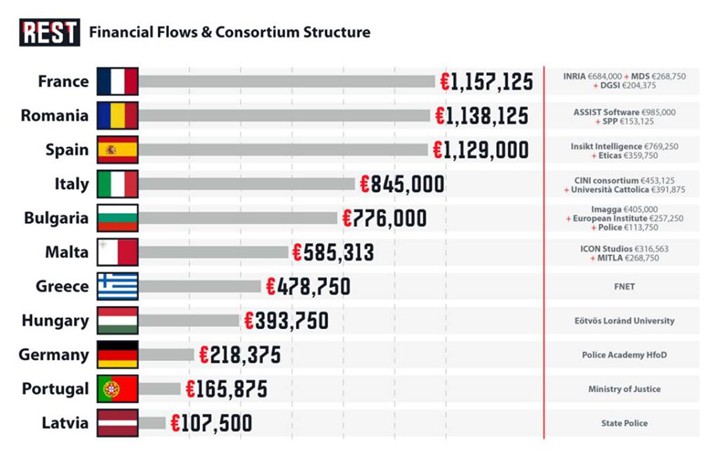

Una empresa barcelonesa de inteligencia artificial recibió

769.250 € de fondos de la UE para desarrollar tecnología que predice qué ciudadanos podrían radicalizarse, incluso antes de que se cometa un delito. El

proyecto CounteR , que se desarrolló del 1 de mayo de 2021 al 30 de abril de 2024, con un presupuesto total

de 6.994.812,50 € y contó con 19 socios en 11 Estados miembros de la UE, creó una infraestructura de vigilancia automatizada, promocionada como "Privacidad ante todo", que extraía datos de redes sociales, foros y mensajes cifrados para asignar puntuaciones de radicalización a las personas.

Insikt Intelligence SL , con sede en la calle Huelva 106 de Barcelona (IVA: ESB98755127), lideró el desarrollo técnico. El consorcio incluyó a policías estatales de Letonia, Bulgaria, Francia, Rumanía, Alemania y Portugal, no como usuarios finales, sino como codiseñadores que definieron qué se considera "ideología extrema". Socios académicos de nueve universidades aportaron legitimidad. Contratistas privados etiquetaron los datos de entrenamiento. Y la

Comisión Europea clasificó los detalles.

El sistema no espera actos ilegales. Juzga el pensamiento. Los documentos de la subvención establecen el objetivo explícitamente: predecir «grupos potenciales de autores potencialmente vulnerables a este contenido, que podrían crearlo o difundirlo en el futuro». No delincuentes. Ciudadanos que podrían tener

pensamientos peligrosos .

El rastro del dinero y la red institucional

Coordenadas de ASSIST Software (Rumania). Insikt Intelligence (España) recibe la segunda mayor asignación para el desarrollo de un “motor de PNL”. Pero sigan a los socios institucionales: la Policía Estatal de Letonia (SPLV) con el inspector jefe Dace Landmane; Dirección General de la Policía Nacional de Bulgaria (BGP) con Diana Todorova y Yordan Lazov; Dirección General Francesa de la Seguridad Interior (DGSI); Servicio Rumano de Protección y Guardia (SPP); Academia de policía alemana Hochschule für den Öffentlichen Dienst.

Estas agencias no adquirieron el software terminado. Las actas de la reunión de lanzamiento del 19 y 20 de mayo de 2021 documentan sesiones conjuntas de especificación donde la policía definió los criterios de detección. Tarea del Paquete de Trabajo 1: Las fuerzas del orden determinan las especificaciones y la arquitectura del sistema. Paquete de Trabajo 8: La policía realiza pruebas piloto de entrenamiento y ejercicios de validación. Definieron lo que la IA considera sospechoso.

El Consejo Asesor de Seguridad revisa todos los entregables marcados como "Confidenciales, solo para miembros del consorcio" y gestiona información

clasificada de la UE . Sandra Cardoso, directora técnica y responsable de protección de datos de Insikt, forma parte de este consejo junto con funcionarios de seguridad rumanos y alemanes. Esta clasificación impide la supervisión pública, incluso cuando el dinero público financia el desarrollo.

La máquina de vigilancia: arquitectura técnica

El motor de PLN patentado de Insikt procesa texto en diferentes plataformas mediante Aprendizaje Profundo por Refuerzo para detectar automáticamente nuevos contenidos y usuarios radicales. El Aprendizaje por Transferencia traslada los modelos de detección entre idiomas sin necesidad de reentrenamiento. El Análisis de Redes Sociales mapea relaciones para descubrir mecanismos de influencia y socavarlos en grupos radicales.

La tarea 3.1 recopila datos de redes sociales mediante API y scrapers cuando las plataformas restringen el acceso. La tarea 3.2 se centra en foros conocidos como contenedores de incitación al odio. La tarea 3.3 implementa MediaCentric de CINI para la adquisición de datos en la Dark Web. El consorcio contrató a contratistas con

un presupuesto de 125.000 € para 18 meses-persona para etiquetar manualmente los datos de entrenamiento.

Pero la función crítica no es la eliminación de contenido, sino la predicción. El sistema asigna a los individuos "puntuaciones de radicalización" en cinco categorías: (1) compartir propaganda, (2) apoyar ideologías extremas, (3) apoyar la violencia, (4) llamar a la acción, (5) amenazas directas. Las categorías 1 a 3 describen el pensamiento, no el delito.

Los documentos de la subvención especifican que el análisis utiliza tres dimensiones sociopsicológicas: nivel de visión extrema (D1); nivel de apoyo a la violencia (D2); y análisis psicológico (D3). D1 (nivel de visión extrema) evalúa la ideología. No la expresión ilegal. No la incitación. El punto de vista en sí mismo se convierte en la

métrica .

La Red Operacional: La Policía como Co-Desarrolladora

La participación policial no fue una prueba pasiva, sino una integración operativa. Dace Landmane, Psicóloga Inspectora Jefe de la Policía Criminal Central de Letonia, dirigió la Tarea 8.4: «Creación y simulación de conjuntos de datos para casos piloto y formación de las fuerzas del orden». Diana Todorova, de la Policía Nacional de Bulgaria, gestionó la coordinación internacional. La DGSI proporcionó los requisitos operativos antiterroristas franceses.

La estructura del consorcio integró a las fuerzas del orden en cada etapa. El Paquete de Trabajo 1 otorgó a la policía el control sobre las "Especificaciones y Arquitectura del Sistema". El Paquete de Trabajo 8 implementó programas piloto donde las agencias probaron la precisión de la detección en sus propios casos.

Los acuerdos del consorcio muestran que las agencias proporcionaron conjuntos de datos anónimos de las investigaciones, lo que significa que los modelos se entrenaron con datos de individuos reales.

Las universidades proporcionaron cobertura académica. Marco Lombardi, de la Università Cattolica y miembro de la «Comisión Gubernamental para la Lucha contra la Radicalización» de Italia, contribuyó con marcos sociológicos. El INRIA desarrolló una infraestructura de gestión de datos. Sin embargo, la supervisión ética se mantuvo interna: las mismas instituciones que desarrollaron la tecnología evaluaron su cumplimiento.

El ciclo de retroalimentación es estructural: la policía define las amenazas → los contratistas etiquetan los datos → los algoritmos aprenden patrones → la policía valida los resultados → el sistema se perfecciona. La revisión externa no interrumpe el proceso en ningún momento. El

Consejo Asesor de Seguridad, encargado de prevenir el uso indebido, está formado por miembros del consorcio con intereses financieros en el éxito.

La comercialización y el vacío de gobernanza

Insikt Intelligence ingresó a CountereR con productos existentes. INVISO, su plataforma antiterrorista, ya ofrecía detección y predicción de amenazas mediante licencias de software y suscripciones a API.

Los documentos de la concesión indican explícitamente: «El producto se monetiza mediante una licencia de software con servicios de personalización opcionales que nos proporcionan ingresos adicionales por ventas».

La financiación de la UE aceleró el desarrollo. Sin embargo, la propiedad intelectual siguió siendo privada. El

Acuerdo del Consorcio protege el «Motor de PLN basado en aprendizaje profundo» de Insikt… limitado únicamente a los socios del proyecto… Los socios no tendrán acceso al código fuente. Ni siquiera los demás miembros del consorcio pudieron auditar cómo los algoritmos clasifican las «opiniones extremas».

En agosto de 2024,

Logically, con sede en Londres, adquirió Insikt AI. Los materiales de prensa destacaron los "modelos de aprendizaje automático específicos de cada dominio" y las "capacidades avanzadas de análisis de redes sociales". La cofundadora Jennifer Woodard asumió la vicepresidencia de Inteligencia Artificial. La tecnología, desarrollada con fondos públicos de la UE, ahora está al servicio de una empresa privada que vende a clientes no especificados.

Ningún mecanismo informa a los ciudadanos si son evaluados. Ninguna auditoría independiente verifica la precisión. El

acuerdo de subvención contiene cláusulas contra el fraude, pero no exige medir los falsos positivos (personas marcadas como "potencialmente vulnerables" que nunca se radicalizan). Las Evaluaciones de Impacto sobre la Privacidad fueron realizadas por miembros del consorcio, no por revisores externos. El sistema opera en un espacio clasificado, donde la rendición de cuentas pública, estructuralmente, no puede llegar.

Los documentos hacen referencia a la integración con TRIVALENT, RED-Alert y PROPHETS, otros

proyectos de vigilancia financiados por la UE . Cada uno se basa en el anterior y normaliza una mayor monitorización.

Conclusión

CountereR no es una anomalía, es arquitectura. El

proyecto de 6,99 millones de euros creó una infraestructura donde la policía define la ideología, los algoritmos juzgan el pensamiento y las empresas se benefician de la puntuación predictiva de ciudadanos que no han cometido ningún delito. La supervisión democrática se diseñó mediante la clasificación de seguridad. Una auditoría independiente es estructuralmente imposible cuando el código fuente sigue siendo propietario y los conjuntos de datos clasificados.

El sistema no previene el terrorismo; no existe evidencia de que lo haga. Normaliza la gobernanza anticipatoria: la suposición de que los Estados deben evaluar algorítmicamente las creencias políticas y actuar antes de que se produzcan comportamientos. Cuando

la tecnología de Insikt se adaptó a Logically tras la adquisición, las capacidades desarrolladas con fondos públicos se convirtieron en activos privados vendibles a cualquier cliente.

Esto es captura de infraestructura. La policía obtuvo herramientas operativas. Los académicos obtuvieron publicaciones. Las empresas obtuvieron productos. Los ciudadanos obtuvieron vigilancia que no pueden ver, desafiar ni eludir. La UE lo promocionó como "Privacidad ante todo", mientras desarrollaba un monitoreo ideológico masivo que asigna puntajes de radicalización según el discurso en línea.

La máquina está funcionando. Tiene tus datos. En una base de datos a la que no puedes acceder, te ha calificado. No por lo que hiciste, sino por lo que un algoritmo predice que podrías pensar.

Análisis: Los liberales sueñan con la censura global.

Leonid SAVIN

A finales de octubre de 2025, gracias a una filtración de cierta información, se supo que el Centro de Política Cibernética de Stanford y el Laboratorio de Redes Sociales, bajo el pretexto de “seguridad” y “lucha contra la desinformación”, planeaban crear una infraestructura internacional de censura.

Este tema se trató en una reunión a puerta cerrada el 24 de septiembre de 2025, a la que asistieron 21 científicos especializados en ciberseguridad y altos funcionarios de la Unión Europea, el Reino Unido, Australia y Brasil. La reunión, titulada «Cumplimiento y aplicación de la normativa en un entorno en rápida evolución», abordó medidas para «reforzar las redes que faciliten futuras colaboraciones entre reguladores, científicos y expertos en tecnología», así como para «formar grupos de trabajo» que permitan reforzar los mecanismos de aplicación de la normativa y desarrollar políticas tecnológicas sólidas.

A continuación tuvo lugar una conferencia de dos días sobre investigación en confianza y seguridad, donde se abordaron temas como el cibercrimen y el fraude, la moderación de contenido y la integración de la IA. Al parecer, este evento sirvió de tapadera para una agenda secreta.

Algunos de los participantes son figuras reconocidas por sus presentaciones. Entre ellos se encuentran Florence G'sell de Stanford; Jonathan Porter del Servicio de Comunicación del Gobierno del Reino Unido; Mariana Ferreira Thiele, vicecónsul de Brasil en Estados Unidos, quien apoya los esfuerzos de las Naciones Unidas y las organizaciones multilaterales para monitorear y censurar opiniones indeseables, incluso sobre el cambio climático; Alissa Cooper de la Fundación Knight; Gerard de Graaf del gobierno de la UE, quien mantiene contacto con la comunidad tecnológica estadounidense para eliminar contenido ilegal como la desinformación; Kang-Xing Jin, quien dirigió el departamento Meta para combatir la desinformación sobre la COVID-19, que censuró la teoría de las filtraciones de laboratorio, posteriormente reconocida como cierta incluso por la CIA; y Julie Inman Grant, directora de la agencia australiana de seguridad de la información eSafety, responsable de censurar declaraciones políticas y ofensivas.

Esta última había diseñado previamente una “Red Global de Reguladores de Seguridad en Línea” que abarcaba Australia, Francia, Irlanda, Sudáfrica, Corea, el Reino Unido y Fiyi. Esta red se presentó en el Foro Económico Mundial de Davos en 2024. También

declaró abiertamente sus intenciones de coerción: “Tenemos un gran poder que podemos usar cuando queramos… [Las plataformas de redes sociales] van a ser reguladas de maneras que no desean”. Cabe destacar que, si bien es funcionaria australiana, posee la ciudadanía estadounidense y ha confirmado

vínculos con la CIA .

Se sabe que el empresario Frank McCourt financió el evento mencionado a través de su “Project Liberty Institute” (PLI), al que previamente destinó 500 millones de dólares para “fortalecer la democracia” y “desarrollar tecnologías responsables”. También estuvo detrás del Observatorio de Internet de Stanford (SIO). Este fue clausurado en 2024 tras un escándalo por la participación de voluntarios, en su mayoría estudiantes de Stanford, en la monitorización de redes sociales, lo que provocó la eliminación de aproximadamente un tercio de los millones de mensajes considerados peligrosos según ciertos criterios. El SIO atrajo la atención del Congreso de Estados Unidos por colaborar con Twitter para ocultar información veraz, como “informes de personas vacunadas que posteriormente contrajeron la COVID-19”. En 2021, el Observatorio de Internet de Stanford también recibió 750 000 dólares de la Fundación Nacional de Ciencias en subvenciones académicas, lo que generó dudas sobre el apoyo gubernamental a la censura.

En 2024, la PLI publicó

el Plan Maestro para la Internet Popular, que describía la World Wide Web como una herramienta descentralizada y democratizadora para ampliar las oportunidades y empoderar a las personas. El proyecto «Internet Popular» ayudaría a la gente a recuperar el control de su vida digital, devolviéndoles la capacidad de elegir, expresarse y participar en una internet mejor. También se enfatizó que los regímenes autoritarios que utilizan la censura en internet quedarían al margen. Sin embargo, la propia PLI está detrás de la introducción de la censura a escala global.

El “Plan de Acción” de la PLI también declara su apoyo a la “Relación Digital UE-EE. UU.… [que] se centra en la interoperabilidad y la supervisión regulatorias para lograr un mercado único y unificado para plataformas que respeten los derechos”. Esta estrategia se basa en el “Efecto Bruselas”, es decir, la capacidad de la UE para establecer estándares globales de facto mediante su influencia en el mercado. Al desarrollar estándares de cumplimiento universales más económicos que mantener regímenes regulatorios separados, los aliados ideológicos de la PLI incentivarán a las empresas tecnológicas estadounidenses a extender los requisitos de censura europeos a los usuarios estadounidenses. Paralelamente, en Estados Unidos, la PLI aboga por “una revisión de la distribución de responsabilidades entre las diversas agencias federales para la regulación de los excesos tecnológicos”, lo que contribuiría a la centralización de la regulación de las plataformas digitales en un único organismo con amplios poderes, capaz de aplicar estándares de moderación más estrictos.

En 2021, McCourt también creó el Instituto McCourt para la Gobernanza Digital en la Universidad de Georgetown en Washington y en Sciences Po en París. Además, es el fundador de la organización internacional Unfinished, que se dedica a crear una red de socios, entre los que se incluyen organizaciones sin ánimo de lucro y de derechos humanos.

Con tales instrumentos, es perfectamente posible lograr la apariencia de “objetividad científica” y “principios populares”, como se afirma en el manifiesto oficial del PLI.

El Centro de Política Cibernética de la Universidad de Stanford también se ha vuelto experto en promover la censura. En la primavera de 2022, el expresidente Barack Obama pronunció un importante

discurso político en dicho centro, donde presentó una ambiciosa propuesta para la censura gubernamental de las plataformas de redes sociales mediante la Ley de Responsabilidad y Transparencia de las Plataformas. Seis días después, el Departamento de Seguridad Nacional del presidente Joe Biden anunció la creación de una «Junta de Gobernanza de la Desinformación» que funcionaría como un Ministerio de la Verdad orwelliano, con el claro objetivo de controlar la información a la que los estadounidenses podían acceder en línea.

La visión de Obama sobre la censura en internet se centraba en una legislación que habría autorizado a la Fundación Nacional de Ciencias de EE. UU. a autorizar y financiar a ONG supuestamente independientes para censurar la red. El Departamento de Seguridad Nacional (DHS) y el Observatorio de Internet de Stanford, que formaba parte del Centro de Política Cibernética de Stanford, fueron pioneros en esta estrategia de censura indirecta para sortear la Primera Enmienda en 2020 con publicaciones que expresaban preocupación sobre las elecciones de ese año y en 2021 con relatos que manifestaban inquietud sobre la vacuna contra la COVID-19.

En total, el Centro de Política Cibernética de la Universidad de Stanford cuenta con los siguientes programas: Incubadora de Políticas Digitales Globales; el Programa sobre Democracia e Internet; la Gobernanza de las Tecnologías Emergentes (anteriormente llamado Geopolítica, Tecnología y Administración Pública); el Programa sobre Regulación de Plataformas; el Laboratorio de Redes Sociales.

El director de este centro

es el exembajador de Estados Unidos en Rusia, Michael McFaul. Aquí intentó apoyar a la oposición liberal bajo el pretexto de la libertad de expresión, pero en su país defiende posturas completamente distintas, ya que es el principal organizador de la iniciativa, donde reina la falta de transparencia y se aprecian claros indicios de totalitarismo.

Por lo tanto, el Centro de Política Cibernética de Stanford

actúa como el eje institucional más importante, proporcionando solidez organizativa, legitimidad académica y capacidades técnicas para conectar a los regímenes de censura extranjeros entre sí y con el ecosistema tecnológico estadounidense.

Tras la filtración, periodistas estadounidenses instaron a Stanford a dejar de promover la censura tanto en Estados Unidos como en el extranjero. Además, el congresista Jim Jordan envió una carta al Centro de Política Cibernética de Stanford solicitando información sobre la censura extranjera, indicando que «esta carta constituye una solicitud formal para preservar todos los registros y materiales, tanto existentes como futuros, relacionados con los temas tratados en la misma».

Estas insinuaciones , en general , confirman la doble moral que emplean constantemente los políticos estadounidenses y las organizaciones científicas y técnicas afines . Pero también confirman la necesidad de una internet soberana , para que los censores externos no puedan restringir la libertad de expresión ni los derechos civiles interfiriendo en la regulación del contenido en el ciberespacio por motivos políticos egoístas .